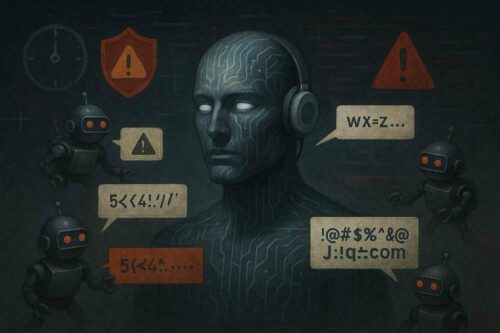

OpenAI admite que los navegadores agénticos siempre serán vulnerables

La separación entre instrucción y dato que los LLM nunca tuvieron En diciembre de 2025, OpenAI publicó algo inusual: una admisión explícita de que el prompt injection en navegadores agénticos es poco probable que se resuelva de forma completa, de la misma manera que no se resuelven las estafas o la ingeniería social en la … Leer más