La manipulación de algoritmos de búsqueda mediante bots es una práctica controvertida, pero comprender su funcionamiento técnico resulta clave para identificar vulnerabilidades y proteger sitios web. Esta guía explora los componentes esenciales para desarrollar y coordinar bots con fines SEO, siempre desde un enfoque educativo y de seguridad informática.

Infraestructura técnica: La base del ejército

Para operar a escala sin ser detectado, se requiere una arquitectura robusta:

- Proxies y rotación de IPs:

Los proxies actúan como intermediarios que ocultan la ubicación real de los bots. Para evitar bloqueos, se utilizan:- Proxies residenciales (IPs de dispositivos reales) y móviles (IPs de redes celulares) para simular tráfico orgánico, tal como se observa en tácticas de click fraud detectadas por Google.

- Rotación inteligente: Cambio automático de IPs cada 5-10 minutos o tras cierto número de solicitudes, usando servicios como Surfshark Nexus o herramientas como Scrapy + Scrapy-Rotating-Proxies, una técnica común en DDoS attacks contra competidores 14.

- Nube distribuida:

Plataformas como AWS Lambda o Google Cloud Functions permiten ejecutar bots en múltiples regiones, imitando acceso global y evitando patrones sospechosos. Esta escalabilidad es crucial para operaciones como link farming, donde se generan redes masivas de enlaces artificiales.

Automatización de tráfico y comportamientos

El objetivo es generar actividad que los motores de búsqueda interpreten como orgánica:

- Herramientas de scraping:

Bibliotecas como Selenium o Puppeteer simulan navegación humana mediante clicks, scroll y tiempos de espera aleatorios. Para sitios con protección anti-bot, se integran soluciones como 2Captcha, que resuelven CAPTCHAs automáticamente, una táctica documentada en casos de cloaking. - Generación de clics y sesiones:

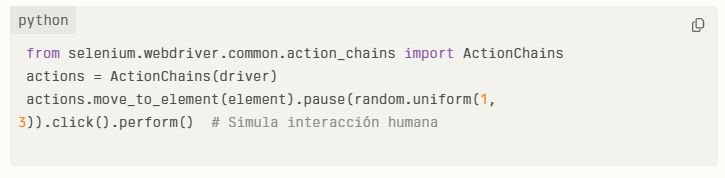

Scripts personalizados en Python o Node.js crean flujos de usuario falsos, imitando desde búsquedas hasta interacciones complejas. Por ejemplo:

Este método se asemeja al click fraud detectado en campañas de CTR manipulation, donde bots generan clics artificiales en anuncios o resultados orgánicos.

- SEO negativo/positivo:

- Spam de backlinks: Bots registran dominios PBN (Private Blog Networks) y publican enlaces masivos usando herramientas como GSA Search Engine Ranker, una práctica vinculada a keyword stuffing y penalizaciones manuales.

- Tráfico fantasma: Herramientas como TrafficBot generan visitas desde keywords específicas, influyendo en tendencias de búsqueda mediante clickbaits y URLs engañosas.

Generación de contenido con IA

La creación automatizada de contenido optimizado es clave para evadir filtros antispam, aunque conlleva riesgos significativos:

- Modelos de lenguaje (LLMs):

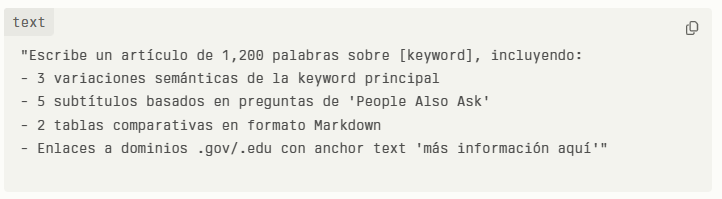

Plataformas como Frase.io o SEOmatic analizan SERPs y generan artículos con densidad de keywords ideal, estructuras HTML optimizadas (h1-h6, meta tags) y LSI keywords. Por ejemplo, un prompt para GPT-4 podría ser:

Este enfoque, aunque eficaz, puede generar contenido superficial que incumple las directrices de E-A-T (Expertise, Authoritativeness, Trustworthiness) de Google.

- Spinning de contenido:

Herramientas como SpinRewriter recombinan párrafos de artículos existentes usando técnicas de NLP como sinónimos contextuales y reestructuración gramatical. Sin embargo, algoritmos como SpamBrain detectan fácilmente estas variaciones si carecen de coherencia semántica.

Coordinación y escalabilidad

Gestionar miles de bots exige sistemas avanzados para evitar patrones detectables:

- Orquestación con Kubernetes:

Clústeres administran contenedores de bots, escalando automáticamente según la demanda. Esta técnica se utiliza en operaciones de DDoS attacks para saturar sitios competidores, aunque adaptada para SEO. - Monitoreo en tiempo real:

Dashboards en Grafana o Kibana trackean métricas clave:- Tasa de éxito de solicitudes (ideal >85%)

- IPs bloqueadas (usando datos de Google Search Console)

- Posiciones en SERPs (mediante Ahrefs API o SEMrush).

- IA para evasión:

Redes neuronales entrenadas con datos de WAF (Web Application Firewalls) predicen y ajustan patrones de tráfico. Por ejemplo, modelos como BERT identifican umbrales de detección de tráfico no orgánico y ajustan la frecuencia de solicitudes.

Mitigación de riesgos

Aunque técnicamente viable, esta práctica conlleva riesgos documentados:

- Detección por motores de búsqueda:

Google emplea algoritmos como SpamBrain, que analizan:- Velocidad de adquisición de backlinks (>100 enlaces/día activan alertas).

- Patrones de clics no orgánicos (ej. sesiones <10 segundos).

- Metatags generados por IA sin coherencia contextual.

- Consecuencias legales y técnicas:

- Penalizaciones manuales: Desindexación parcial o total del sitio.

- Litigios: Violación de términos de servicio de AWS o Google Cloud, con multas de hasta $500 USD por infracción.

Conclusión: Ética y prevención

Mientras esta guía ilustra métodos técnicos, su aplicación conlleva implicaciones legales y éticas. Para webmasters, comprender estas tácticas es crucial para:

- Implementar medidas anti-bots (Cloudflare Bot Management, DataDome).

- Monitorizar backlinks tóxicos mediante Google Search Console.

- Usar IA éticamente en estrategias SEO (SurferSEO, MarketMuse).

La manipulación algorítmica puede ofrecer ganancias a corto plazo, pero solo el contenido auténtico y el SEO white hat garantizan sostenibilidad. Estudios de casos como el colapso de BMW en 2006 (penalizado por cloaking) demuestran que las tácticas agresivas fracasan ante actualizaciones como Penguin o BERT.

Fuentes técnicas:

- Gestión de proxies para bots

- CTR Manipulation: Risks and Detection

- Ethical AI Content Generation

- SEO Penalties Case Studies

Disclaimer: Este contenido es educativo. No respaldamos prácticas que violen políticas de motores de búsqueda.